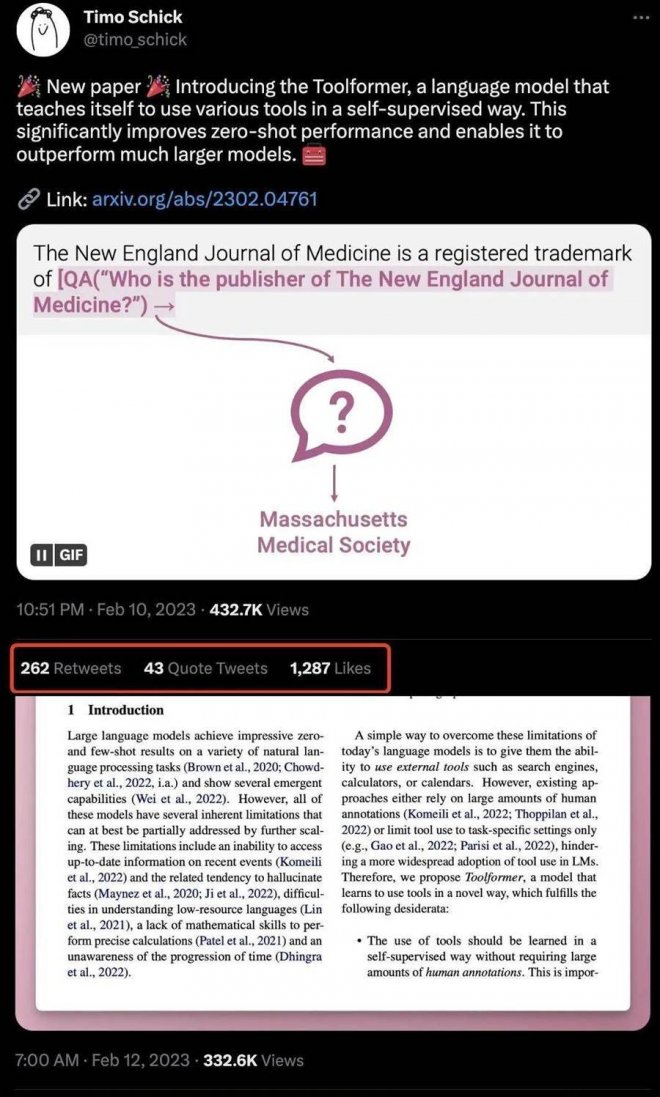

讓ChatGPT長「手」!Meta爆火新論文,讓語言模型學會自主用工具

ChatGPT爆火,Meta也坐不住了。微軟和谷歌正在搜索引擎那邊刺刀拼刺刀呢,誰想Meta冷不防拋出一篇新論文,頓時吸引全場目光:

瞄準ChatGPT的「軟肋」,讓大語言模型 自行學會了使用工具!

簡單來說,基于Meta的這個思路,ChatGPT這些大語言模型可以缺啥補啥:

不會算數,就自己掏出計算器計算;需要最新信息,就自己連接搜索引擎搜索……

是不是有點AI自己操作自己內味兒了?

論文一出,不少AI研究者就將其視作「 過去幾周里最重要的論文」。

這篇論文給人們打開了思路,讓大語言模型未來可以成為所有事情的起點。

還有網友表示:我老婆原本不太關心AI,聽說Meta這論文都驚了。普通人真的得好好想想這事兒了。

自學工具用法的大語言模型這一回,Meta給這個會使工具的語言模型起名 Toolformer。

Toolformer的內核邏輯,總結下來很簡單,就是:

專業的任務交給專業的工具來做。

在生成文本的過程中,遇到特定的任務,Toolformer會直接調用所需工具的API。

比如說,在執行這個任務:1400名參與者,有400人通過了測試,占多大比例?(為了讓ChatGPT掌握數學運算,OpenAI可沒少折騰)

Toolformer絲毫不慌,直接「掏出」計算器,現場計算得出結果: 29%。

又或者說,想要備注個事情,只知道是周五,具體日期還不知道?

沒關系,翻出日歷查一下就好了。

甚至翻譯任務也可以直接丟給它,各國語言都能夠識別并翻譯,直接省去了在軟件切換語言的工夫。

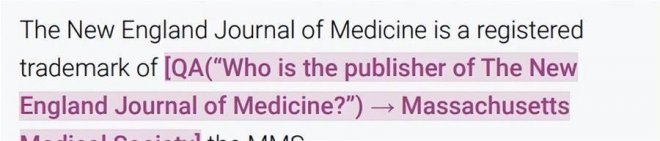

除了這些工具之外,Toolformer還能夠調用Q&A以及搜索引擎等工具。

這時,就已經有網友開始暢想未來了:

現在,ChatGPT版必應能幫你比較酒店價格,那未來有了Toolformer,預定性價比高的酒店豈不是也可以甩給AI去做了。

不過話說回來,Toolformer面對不同的任務都能行云流水般地調用對應的工具,它是怎麼做到的呢?

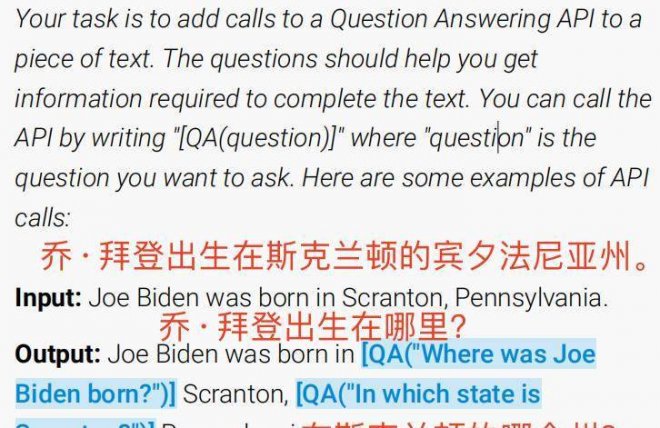

一言以蔽之,Toolformer經過訓練,能夠在生成文本中[插·入]API調用,直接將任務外包出去。

在這其中,訓練的過程是以 自監督的方式完成的。這意味著無需大量人類標注好的數據,Toolformer只需要少量演示就能學會調用API。

具體來說,先給Toolformer提供少量已經手動標注好的例子,然后讓語言模型在實踐中 生成一個更大的包含示例的數據集。

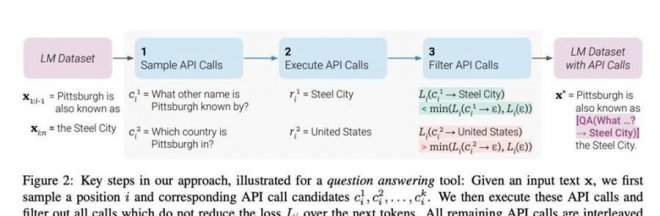

這個過程主要分成三步:

首先是 取樣,通俗點講就是看輸入的文本提示中,哪個地方需要調用哪種工具,然后直接將「調用的API」[插·入]到對應的地方;

其次是 執行,執行上一步的「調用API」任務,將生成的文本直接[插·入]進去;

最后是 過濾,上一步中工具生成的文本如果對輸入文本來說用處不大的話,就可以直接pass掉,保留對文本有用的地方。

這樣一來,基于這些有用的數據集,Toolformer便可以對預先訓練好的大語言模型進行微調。

講了這麼多,Toolformer的真實效果到底如何,有沒有一個橫向的數據對比?

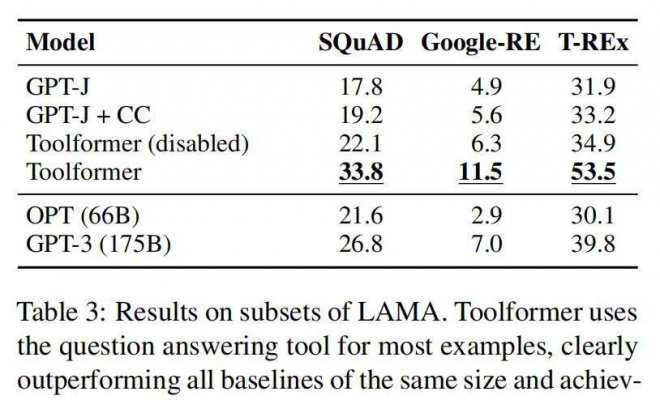

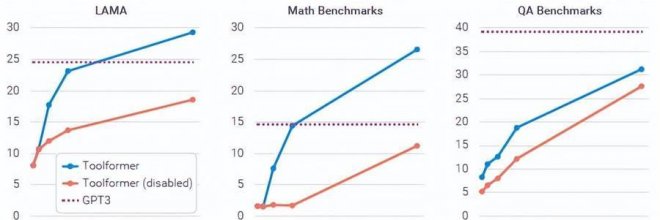

論文將Toolformer和多個其他大語言模型,包括GPT-J,OPT(66B)以及GPT-3(175B)進行了對比,比較了它們在數學、Q&A以及機器翻譯等方面的能力。

結果顯示,在學習使用工具后,GPT-J的零樣本學習性能的到了顯著的提高。

△Toolformer:是在GPT- J上微調,并加強了CCNet子集中的API調用/ Toolformer (disabled):同上,但解碼期間禁用API調用并且在大多數任務上性能都有明顯提高,在一些下游任務中Toolformer甚至已經超過了GPT-3。

「未來大語言模型發展的重要分支」說到這里,不知道你怎麼看這件事兒。

有不少網友是已經按捺不住,想著去拔AI電源了。

而引發更多討論的,是這樣一種觀點:Toolformer可能是未來LLM(大語言模型)發展的一個重要分支。

大語言模型進化出使用工具的能力,知道應該在何時、使用何種工具來實現需求,也就意味著許多在今天還需要人類和AI協作完成的工作,未來AI都能自己搞定了。

比如現在還多少有些「人工智障」的語音助手,如果背后有ChatGPT+Toolformer的技術能力支撐,那麼從挑選符合需求的餐廳,到直接訂座,這一系列動作都可以被絲滑地串聯起來。

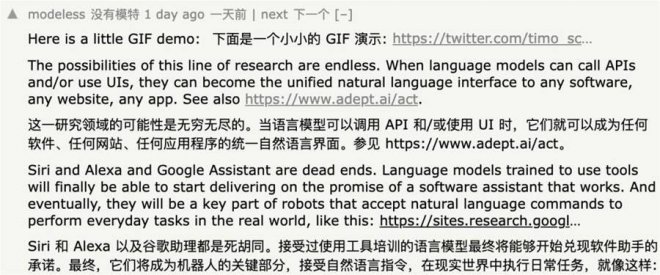

又比如微軟的必應搜索接入ChatGPT。如果這些大語言模型能充分調用各種API、使用UI,那它不僅能幫人們完成搜索,還能完全改變人們操作網頁的方式——一切輸入都可以化簡為自然語言。

甚至,ChatGPT這樣的模型,借助各種API重寫自己的代碼,也將成為可能。

事實上,讓AI掌握工具的使用方法這個研究方向,也并不只有Meta在做。

比如谷歌即將嵌入到搜索中的 Bard,背后模型LaMDA就內置了一套工具箱,包括計算器、翻譯器和訪問搜索引擎獲取外部信息的接口。

還有開源項目 LangChain,也致力于將大語言模型與外部的計算、知識來源相結合,以開發真正可用的應用程序。

而現在,Meta又使大模型對工具的使用「熟練度」、「自主性」,更上一層樓。

不過,也有網友指出,Toolformer所展現出的「自學」能力,還是一個初級、「狹義」的版本。

這些模型本身仍然是純粹的函數:給定相同的輸入(包括采樣時的隨機值),它將總是產生相同的輸出。有點像是在說,一個大語言模型能學會將特定領域的語言作為其自然語言的一部分,以此納入來自外部工具的知識。

One More ThingMeta新論文炸場,還挑動了人類的「反思」神經。

[圖擷取自網路,如有疑問請私訊]

|

本篇 |

不想錯過? 請追蹤FB專頁! |

| 喜歡這篇嗎?快分享吧! |

相關文章

科普解密